что такое мера информации

Что такое мера информации

Классификация мер

Для измерения информации вводятся два параметра: количество информации I и объем данных VД.

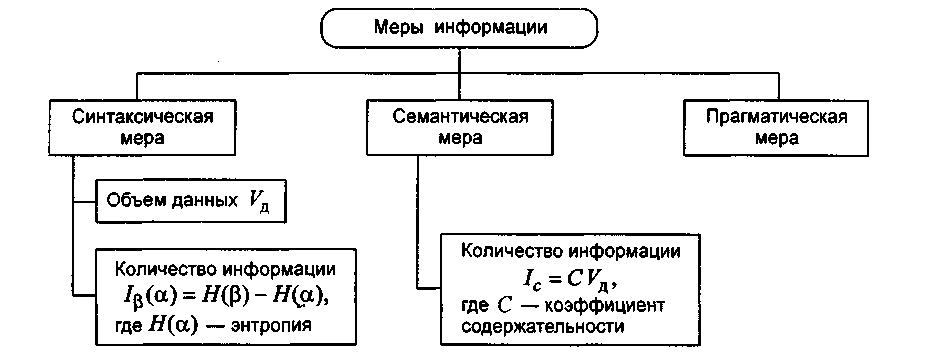

Эти параметры имеют разные выражения и интерпретацию в зависимости от рассматриваемой формы адекватности. Каждой форме адекватности соответствует своя мера количества информации и объема данных (рис. 2.1).

Рис. 2.1. Меры информации

Синтаксическая мера информации

Эта мера количества информации оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту.

Объем данных VД в сообщении измеряется количеством символов (разрядов) в этом сообщении. В различных системах счисления один разряд имеет различный вес и соответственно меняется единица измерения данных:

• в двоичной системе счисления единица измерения — бит (bit — binary digit — двоичный разряд);

Примечание. В современных ЭВМ наряду с минимальной единицей измерения данных «бит» широко используется укрупненная единица измерения «байт», равная 8 бит.

• в десятичной системе счисления единица измерения — дат (десятичный разряд).

Пример 2.3. Сообщение в двоичной системе в виде восьмиразрядного двоичного кода 10111011 имеет объем данных VД = 8 бит.

Сообщение в десятичной системе в виде шестиразрядного числа 275903 имеет объем данных VД = 6 дит.

Количество информации I на синтаксическом уровне невозможно определить без рассмотрения понятия неопределенности состояния системы (энтропии системы). Действительно, получение информации о какой-либо системе всегда связано с изменением степени неосведомленности получателя о состоянии этой системы. Рассмотрим это понятие.

Пусть до получения информации потребитель имеет некоторые предварительные (априорные) сведения о системе α. Мерой его неосведомленности о системе является функция H(α), которая в то же время служит и мерой неопределенности состояния системы.

После получения некоторого сообщения β получатель приобрел некоторую дополнительную информацию Iβ(α), уменьшившую его априорную неосведомленность так, что апостериорная (после получения сообщения β) неопределенность состояния системы стала Hβ(α).

Тогда количество информации Iβ(α) о системе, полученной в сообщении β, определится как

т.е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы.

Если конечная неопределенность Hβ(α) обратится в нуль, то первоначальное неполное знание заменится полным знанием и количество информации Iβ(α) = H(α). Иными словами, энтропия системы H(α) может рассматриваться как мера недостающей информации.

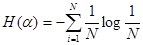

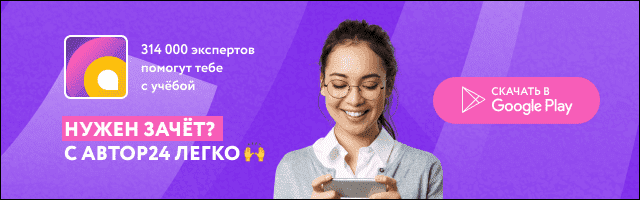

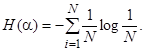

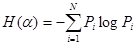

Энтропия системы H(α), имеющая N возможных состояний, согласно формуле Шеннона, равна:

где pi — вероятность того, что система находится в i-м состоянии.

Дня случая, когда все состояния системы равновероятны, т.е. их вероятности равны Pi =

Часто информация кодируется числовыми кодами в той или иной системе счисления, особенно это актуально при представлении информации в компьютере. Естественно, что одно и то же количество разрядов в разных системах счисления может передать разное число состояний отображаемого объекта, что можно представить в виде соотношения

где N — число всевозможных отображаемых состояний;

т — основание системы счисления (разнообразие символов, применяемых в алфавите); п — число разрядов (символов) в сообщении.

Меры информации

Информационный процесс

Информация динамична, она существуют непродолжительное время – столько, сколько продолжается взаимодействие данных и методов во время ее создания, потребления или преобразования. Как только взаимодействие завершается, опять в наличии данные, но уже представленные в другой форме.

Пока идет лекция студенты, используя наблюдение и прослушивание, получают информацию от преподавателя. Лекция закончилась, информация сохраняется в виде данных в коре головного мозга. На экзамене у того же преподавателя идет совершенно другой информационный процесс, студент рассказывает содержание темы, но при этом преподаватель получает совершенно другие данные и применяет к ним совершенно иные методы. В результате он получает иную информацию, которая преобразуется в данные, хранящиеся в зачетке и в ведомости на экзамен.

Подобная схема действует и в технике. Например, информационный процесс на телевидении:

Аппаратные методы: видеокамера – передающее устройство – антенна-предатчик – спутник – антенна-приемник – телевизор.

Естественные методы: зрение – головной мозг.

Информационный процесс – это всегда цикл образования информации из данных и немедленного их сохранения в виде новых данных. Информация существует непродолжительное время, но информационный процесс длится столько, сколько существуют носители данных, представляющие информацию.

Понимая информацию как один из стратегических ресурсов общества, необходимо уметь его оценивать как с качественной, так и с количественной стороны. Здесь возникают проблемы из-за нематериальной природы этого ресурса и субъективного восприятия конкретной информации каждым конкретным человеком.

Для измерения информации вводятся два параметра: количество информации I и объем данных Vд. Эти параметры имеют разные выражения и интерпретацию в зависимости от рассматриваемой меры количества информации и объема данных.

Синтаксическая мера информации.

Эта мера оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту. Объем данных Vд в сообщении измеряется количеством символов (разрядов) в этом сообщении.

В различных системах счисления один разряд имеет различный вес и соответственно меняется единица измерения данных:

— в двоичной системе счисления единица измерения – бит (bit – binary digit) или более укрупненная единица байт, равная 8 бит. Сообщение, записанное двоичным кодом 10111011, имеет объем данных 8 бит или 1 байт.

— в десятичной системе счисления единица измерения – дит (десятичный разряд). Сообщение, записанное числом 275903 имеет объем данных 6 дит.

Количество информации I на синтаксическом уровне определяется с помощью понятия неопределенности состояния (энтропии) системы.

Если конечная неопределенность Hβ(α) обратится в нуль, то первоначальное неполное знание заменится полным знанием и количество информации Iβ(α) = H(α). Иными словами, энтропия системы H(α) может рассматриваться как мера недостающей информации.

Энтропия системы H(α), имеющая N возможных состояний, согласно формуле Шеннона, равна:

где Pi – вероятность того, что система находится в i-состоянии.

Для случая, когда все состояния системы равновероятны, т.е. их вероятности равны Pi = 1/N, ее энтропия определяется соотношением.

Часто информация кодируется числовыми кодами в той или иной системе счисления, особенно это актуально при представлении информации в компьютере. Естественно, что одно и то же количество разрядов в разных системах счисления может передать разное число состояний отображаемого объекта, что можно представить в виде соотношения

где N – число всевозможных отображаемых состояний;

m – основание системы счисления (разнообразие символов, применяемых в алфавите);

n – число разрядов (символов) в сообщении.

Если в качестве основания логарифма принять m, то I = n. В данном случае количество информации (при условии полного априорного незнания абонентом содержания сообщения) будет равно объему данных I = Vд, полученных по каналу связи. Для неравновероятностных состояний системы всегда I

Меры информации

Количество информации и единицы ее измерения.

Теория информации рассматривает следующие меры количества информации:

I. Синтаксическая мера информацииоперирует с обезличенной информацией, не выражающей смыслового отношения к объекту. На этом уровне объем данных в сообщении измеряется количеством символов в этом сообщении.

Рассмотрим два подхода к измерению синтаксической информации.

1. Содержательный подход. Информация измеряется в битах, байтах и т.д., т.е. для определения количества применяется двоичная система счисления. Минимальная единица – бит.

Количество информации i, содержащееся в сообщении о том, что произошло одно из N равновероятных событий, определяется из решения показательного уравнения

Эту формулу в 1928 году вывел Ричард Хартли. В ней

N – количество равновероятных событий,

n – число разрядов (символов в сообщении),

m – основание системы счисления.

Для двоичной системы счисления m = 2, n = i, т.о.

2 i = N, или i = log 2 N (3)

Эта формула является частным случаем формулы Клода Шеннона, когда количество информации определяется не через количество возможных равновероятных событий, а через вероятность. Величина вероятности определяется в долях или процентах и

0% i = 1/P или i = log 2 (1/P) (4)

P – вероятность события. Чем меньше вероятность, тем больше информации.

II. Семантическая мера информации используется для измерения смыслового содержания информации. Наибольшее распространение здесь получила тезаурусная мера, предложенная Ю.И. Шнейдером (идеи тезаурусного метода были сформулированы еще основоположником кибернетики Н. Винером) и связывающая семантические свойства информации со способностью пользователя принимать поступившее сообщение. Для понимания и использования информации ее получатель должен обладать определенным запасом знаний.

Тезаурус — это совокупность сведений, которыми располагает пользователь или система. Максимальное количество семантической информации потребитель получает при согласовании ее смыслового содержания со своим тезаурусом, когда поступающая информация понятна пользователю и несет ему ранее не известные сведения.

Семантический подходопределения количества информации является наиболее трудно формализуемым и до сих пор окончательно не определившимся. Тем не менее…:

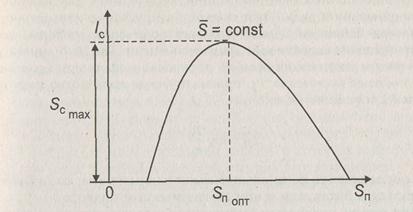

Если индивидуальный тезаурус потребителя Sпотражает его знания о данном предмете, то количество смысловой информации Iс, содержащееся в некотором сообщении, можно оценить степенью изменения этого тезауруса, произошедшего под воздействием данного сообщения. Очевидно, что количество информации Iс нелинейно зависит от состояния индивидуального тезауруса пользователя, и хотя смысловое содержание сообщения Sп постоянно, пользователи, имеющие различные тезаурусы, будут получать неодинаковое количество информации. В самом деле, если индивидуальный тезаурус получателя информации близок к нулю (Sп

0), то в этом случае и количество воспринятой информации равно нулю: Iс = 0.

Иными словами, получатель не понимает принятого сообщения и, как следствие, для него количество воспринятой информации равно нулю. Такая ситуация эквивалентна прослушиванию сообщения на неизвестном иностранном языке.

Несомненно, сообщение не лишено смысла, однако оно непонятно, а значит, не имеет информативности.

Количество семантической информации Icв сообщении также будет равно нулю, если пользователь информации абсолютно все знает о предмете, т.е. его тезаурус Sпи сообщение не дают ему ничего нового.

Интуитивно мы чувствуем, что между этими полярными значениями тезауруса пользователя существует некоторое оптимальное значение Sпопт при котором количество информации Ic, извлекаемое из сообщения, становится для получателя максимальным. Эта функция зависимости количества информации Icот состояния индивидуального тезауруса пользователя Sп приведена на рисунке.

Тезаурусный метод подтверждает тезис о том, что информация обладает свойством относительности и имеет, таким образом, относительную, субъективную ценность. Для того чтобы объективно оценивать научную информацию, появилось понятие общечеловеческого тезауруса, степень изменения которого и определяла бы значительность получаемых человечеством новых знаний.

III. Прагматическая мера информацииопределяет ее полезность, ценность для процесса управления. Обычно ценность информации измеряется в тех же единицах, что и целевая функция управления системой.

Прагматический подход определяет количество информации как меры, способствующей достижению поставленной цели. Одной из первых работ, реализующей этот подход, явилась статья А.А. Харкевича. В ней он предлагал принять за меру ценности информации количество информации, необходимое для достижения поставленной цели. Этот подход базируется на статистической теории Шеннона и рассматривает количество информации как приращение вероятности достижения цели. Так, если принять вероятность достижения цели до получения информации равной Ро, а после ее получения Р1, прагматическое количество информации Iп определяется как

Iп = log Р1/ Ро

Если основание логарифма сделать равным двум, то Iп будет измеряться в битах, как и при синтаксическом подходе.

При оценке количества информации в семантическом и прагматическом аспектах необходимо учитывать и временную зависимость информации. Дело в том, что информация, особенно в системах управления экономическими объектами, имеет свойство стареть, т.е. ее ценность со временем падает, и важно использовать ее в момент наибольшей ценности.

Нам важно ваше мнение! Был ли полезен опубликованный материал? Да | Нет

ЦП Автоматизированные системы управления и промышленная безопасность

БК Автоматизированные системы управления и кибернетика

2. Меры и единицы представления, измерения и хранения информации

Количественные характеристики информации

Классификация мер информации представлена на рис.1.

Рис. 1. Классификация мер информации

Синтаксическая мера информации оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту. На синтаксическом уровне учитываются тип носителя и способ представления информации, скорость передачи и обработки, размеры кодов представления информации.

Существуют два основных подхода в определении количества информации. Исторически они возникли почти одновременно. В конце 40-х г. XX века один из основоположников кибернетики, американский математик Клод Шеннон развил вероятностный подход к измерению количества информации, а работы по созданию ЭВМ привели к «объемному» подходу.

Объём данных (VД) понимается в техническом смысле этого слова как информационный объём сообщения или как объём памяти, необходимый для хранения сообщения без каких-либо изменений.

Информационный объём сообщения измеряется в битах и равен количеству двоичных цифр (“0” и “1”), которыми закодировано сообщение.

В компьютерной практике слово “бит” используется также как единица измерения объёма памяти. Ячейка памяти размером в 1 бит может находиться в двух состояниях (“включено” и “выключено”) и в неё может быть записана одна двоичная цифра (0 или 1). Понятно, что бит – слишком маленькая единица измерения информации, поэтому пользуются кратными ей величинами. Основной единицей измерения информации является байт. 1 байт равен 8 битам. В ячейку размером в 1 байт можно поместить 8 двоичных цифр, то есть в одном байте можно хранить 256 = 2 8 различных чисел. Для измерения ещё больших объёмов информации используются следующие величины:

1 Кбайт (один килобайт) = 2 10 байт = 1024 байта (1 kB );

1 Мбайт (один мегабайт) = 2 10 Кбайт = 1024 Кбайта (1 MB );

1 Гбайт (один гигабайт) = 2 10 Мбайт = 1024 Мбайта (1 GB );

1 Тбайт (один терабайт) = 2 10 Гбайт = 1024 Гбайта (1 TB );

1 Пбайт (один петабайт) = 2 10 Тбайт = 1024 Тбайта (1 PB );

1 Эбайт (один эксабайт) = 2 10 Пбайт = 1024 Пбайта (1 EB );

1 Збайт (один зеттабайт) = 2 10 Эбайт = 1024 Эбайта (1 ZB );

1 Йбайт (один йоттабайт) = 2 10 Збайт = 1024 Збайта (1 YB ).

При вероятностном подходе количество информации I на синтаксическом уровне определяется через понятие энтропии системы.

Пусть до получения информации потребитель имеет некоторые предварительные (априорные) сведения о системе α. Мерой его неосведомленности о системе является функция H(α), которая в то же время служит и мерой неопределенности состояния системы.

После получения некоторого сообщения β получатель приобрел некоторую дополнительную информацию Iβ(α), уменьшившую его априорную неосведомленность так, что неопределенность состояния системы после получения сообщения β стала Hβ(α).

Тогда количество информации Iβ(α) о системе, полученной в сообщении β, определится как

т.е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы. Если конечная неопределенность Hβ(α) обратится в нуль, то первоначальное неполное знание заменится полным знанием и количество информации будет определяться как Iβ(α) = H(α). Иными словами, энтропия системы Н(а) может рассматриваться как мера недостающей информации.

Энтропия системы H(α), имеющая N возможных состояний, согласно формуле Шеннона, равна:

Пример 2. Часто информация кодируется числовыми кодами в той или иной системе счисления, особенно это актуально при представлении информации в компьютере. Естественно, что одно и то же количество разрядов в разных системах счисления может передавать разное число состояний отображаемого объекта, что можно представить в виде соотношения

m – основание системы счисления (разнообразие символов, применяемых в алфавите);

n – число разрядов (символов) в сообщении.

Если в качестве основания логарифма принять m, то I = n. В данном случае количество информации (при условии полного априорного незнания абонентом содержания сообщения) будет равно объему данных I = VД, полученных по каналу связи.

Наиболее часто используются двоичные и десятичные логарифмы. Единицами измерения в этих случаях будут соответственно бит и дит.

Семантическая мера информации

Для измерения смыслового содержания информации, т.е. ее количества на семантическом уровне, наибольшее признание получила тезаурусная мера, которая связывает семантические свойства информации со способностью пользователя принимать поступившее сообщение. Для этого используется понятие «тезаурус пользователя».

Тезаурус – это совокупность сведений, которыми располагает пользователь или система.

В зависимости от соотношений между смысловым содержанием информации S и тезаурусом пользователя Sp изменяется количество семантической информации Ic,воспринимаемой пользователем и включаемой им в дальнейшем в свой тезаурус. Характер зависимости количества семантической информации, воспринимаемой потребителем, от его тезауруса показан на рис. 2.

Рис. 2. Характер зависимости количества семантической информации от его тезауруса

Рассмотрим два предельных случая, когда количество семантической информации Icравно 0:

• при пользователь не воспринимает и не понимает поступающую информацию;

• при пользователь все знает, и поступающая информация ему не нужна.

Максимальное количество семантической информации Ic потребитель приобретает при согласовании ее смыслового содержания S со своим тезаурусом Sp (Sp = Sp opt), когда поступающая информация понятна пользователю и несет ему ранее не известные (отсутствующие в его тезаурусе) сведения. Следовательно, количество семантической информации в сообщении, т.е. количество новых знаний, получаемых пользователем, является величиной относительной. Одно и то же сообщение может иметь смысловое содержание для компетентного пользователя и быть бессмысленным для пользователя некомпетентного.

Прагматическая мера информации (аксиологический подход)

Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цепи. Эта мера также является величиной относительной, обусловленной особенностями использования этой информации в той или иной системе.

Ценность информации целесообразно измерять в тех же самых единицах (или близких к ним), в которых измеряется целевая функция.

Представим для сопоставления введённые меры информации в таб. 1.

Таб. 1. Меры информации

Информация. мера и качество информации

Информация(от лат. informatio — формирование как выявление своей сущности, разъяснение, изложение, осведомление) — значимые сведения о чём-либо, когда форма их представления также является информацией, то есть имеет форматирующую функцию в соответствии с собственной природой.

В современной науке рассматриваются два вида информации:

Объективная (первичная) информация — свойство материальных объектов и явлений (процессов) порождать многообразие состояний, которые посредством взаимодействий (фундаментальные взаимодействия) передаются другим объектам и запечатлеваются в их структуре[1].

Субъективная (семантическая,смысловая, вторичная) информация – смысловое содержание объективной информации об объектах и процессах материального мира, сформированное сознанием человека с помощью смысловых образов (слов, образов и ощущений) и зафиксированное на каком-либо материальном носителе.

В бытовом смысле информация — сведения об окружающем мире и протекающих в нём процессах, воспринимаемые человеком или специальным устройством[2].

В настоящее время не существует единого определения информации как научного термина. С точки зрения различных областей знания, данное понятие описывается своим специфическим набором признаков. Согласно концепции К.Шеннона, информация — это снятая неопределенность, т.е. сведения, которые должны снять в той или иной степени существующую у потребителя до их получения неопределенность, расширить его понимание объекта полезными сведениями.

С точки зрения Грегори Бейтсона, элементарная единица информации это небезразличное различие (the difference that makes a difference) или действенное различие для какой-то большей воспринимающей системы. Те различия которые не воспринимаются он называет потенциальными, а воспринимаемые — действенными. Информация состоит из небезразличных различий(с) Любое восприятие информации с необходимостью является получением сведений о различии(с)

С точки зрения информатики, информация обладает рядом фундаментальных свойств: новизна, актуальность, достоверность, объективность, полнота, ценность и др.

1.Объективность и субъективность. Понятие объективности является относительным, т.к. методы являются субъективными. Более объективной принято считать ту информацию, в которую методы вносят меньший субъективный элемент.

2. Достоверность. Данные возникают в момент регистрации сигналов, но не все сигналы являются полезными, всегда присутствует уровень посторонних сигналов. Если полезный сигнал зарегистрирован четко, чем посторонний сигнал уровень доступности будет высокий. При увеличении уровня шумов достоверность информации снижается.

3. Полнота. Характеризует качество информации и определяет достаточность данных для принятия решений или для создания данных на основе имеющихся.

4. Адекватность. Степень соответствия реальному объективному состоянию дела. Неадекватная информация может образоваться при создании новой информации на основе неполных или недостоверных данных.

5. Доступность. Мера возможности получить ту или иную информацию. На степень доступности информации влияют одновременно как доступность данных, так и адекватность.

6. Актуальность. Степень соответствия информации данному моменту времени.

Меры информации

Синтаксические меры информации. Объем данных в сообщении измеряется количеством символов (разрядов) принятого алфавита в этом сообщении. Часто информация кодируется числовыми кодами в той или иной системе счисления. Естественно, что одно и то же количество разрядов в разных системах счисления способно передать разное число состояний отображаемого объекта.

Семантическая мера информации. Для измерения смыслового содержания информации, то есть ее количества на семантическом уровне, наибольшее признание получила тезаурусная мера информации, которая связывает семантические свойства информации со способностью пользователя воспринимать поступившее сообщение.

Прагматическая мера информации Прагматическая мера информации — это полезность информации, ее ценность для пользователя (управления). Эта мера также является величиной относительной, обусловленной особенностями использования информации в той или иной системе управления. Ценность информации целесообразно измерять в тех же самых единицах (или близких к ним), в которых измеряется целевая функция.( http://halyavalovis.ru/1/vsst/38-1.-informacija-ee-svojjstva.-mery-informacii.html и http://ru.wikipedia.org/wiki/%D0%98%D0%BD%D1%84%D0%BE%D1%80%D0%BC%D0%B0%D1%86%D0%B8%D1%8F)