что такое дипфейк понятным языком

Дипфейки: что это за технология и почему она опасна

Слово deepfake появилось несколько лет назад. Оно объединяет в себе два понятия: глубокое обучение (deep learning), то есть обучение нейросетей, и подделку (fake). Технология дипфейков заключается в синтезе ИИ человеческих изображений: алгоритм объединяет несколько фото, на которых человек изображен с разным выражением лица, и делает из них видео. При этом ИИ анализирует большое количество снимков и учится тому, как может выглядеть и двигаться конкретный человек. Об этом пишет американское издание Forbes.

С распространением дипфейков появились случаи «дискредитации» публичных личностей, чьих изображений много в открытом доступе. Например, весной 2019 года в Сети было опубликовано дипфейк-видео со спикером палаты представителей конгресса США Нэнси Пелоси. Автор ролика с помощью ИИ изменил речь Пелоси так, что она плохо выговаривала слова, и пользователи, посмотревшие видео, посчитали, что политик пьяна. Ситуация вылилась в громкий скандал, и лишь спустя некоторое время было доказано, что речь Пелоси была сгенерирована ИИ.

Этот дипфейк был сделан достаточно просто. Но есть и сложные алгоритмы. Они не просто меняют тембр голоса или замедляют речь, а генерируют такие видео, на которых человек делает то, чего никогда не совершал, или говорит то, чего никогда не говорил. Со временем дипфейки будут становиться все более реалистичными, пишет американское издание Forbes. Уже сейчас технология претендует на то, чтобы влиять на политику, а в дальнейшем такие видео и вовсе смогут стать угрозой национальной безопасности.

Вооруженный глаз: как распознать дипфейк

Дипфейки — это видеоролики, в которых одно лицо подменяется другим с помощью алгоритмов машинного обучения. Если несколько лет назад подобные имитации были довольно топорными и вызывали большей частью смех, то сегодня технология качественно эволюционировала. И, как это часто бывает с новинками, немедленно была взята на вооружение криминалом. Сгенерированный компьютером голос начальника просит сотрудника перевести крупную сумму, а звезд шоу-бизнеса и политиков терроризируют фальшивыми порнороликами с их участием. Эксперты прогнозируют, что по мере сбора биометрических данных риск мошенничества возрастает. Как распознать дипфейк и какие меры вводятся для борьбы с подобного рода манипуляциями — в материале «Известий».

Кейдж и обнаженка

Считается, что первые дипфейки появились в конце 2017 года, когда пользователь Deepfakes выложил на Reddit порнографические ролики, в которых лица актеров были заменены на лица голливудских звезд. Технология разошлась по Сети и породила массу подобного контента. Чуть позже, наигравшись с роликами для взрослых, пользователи взялись за Николаса Кейджа. С помощью приложения FakeApp, запущенного в январе 2018-го, американский актер был помещен в фильмы, в которых никогда не принимал участия. А несовершенность технологии только прибавила видео веселости.

В дальнейшем опыты стали более разнообразными: Сильвестр Сталлоне «превратился» в мальчика Кевина из фильма «Один дома», Арнольд Шварценеггер «сыграл» всех персонажей во «Властелине колец», а Илон Маск «исполнил» песню «Трава у дома».

Между дипфейками есть свои различия. Наверняка многие встречали видео, на которых пользователи «примеряют маску» знаменитых политиков, дарят им свою артикуляцию и заставляют говорить странные вещи. Данный метод называется Face2Face. Подделка создается в режиме реального времени и в отличие от собственно DeepFake не подменяет одно лицо другим, а искажает мимику исходного объекта.

Однако в последние годы термин deepfake используется в широком смысле — им обозначают все типы имитирующих видео, созданных искусственным интеллектом.

Механизм работы

Дипфейки создаются при помощи метода глубокого обучения, известного как генеративно-состязательная сеть (GAN). Его суть заключается в соревновании двух нейросетей: генератора и дискриминатора. Генератор создает подделку, а дискриминатор пытается понять, настоящее перед ним изображение или нет. Чем лучше обманывает генератор, тем выше конечный результат.

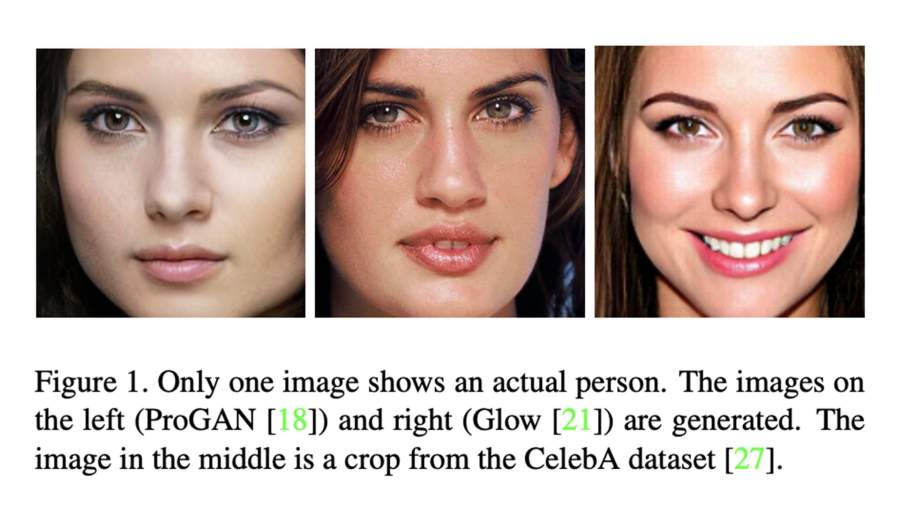

Прежде созданные GAN изображения отличались довольно низким разрешением. По размытости картинки можно было легко идентифицировать запись как сгенерированную. Это ограничение было преодолено в версии ProGAN, благодаря которой разрешение подскочило до 1024×1024 пикселей.

Другая модель — StyleGAN — научилась мастерски создавать лица несуществующих людей. Нейросеть обучилась на библиотеке реальных фотопортретов и стала сама генерировать человеческие образы.

Насколько высоки результаты в генерации новых лиц, можно убедиться на примере картинки ниже. Только на одной из трех фотографий изображена реальная девушка. Она посередине.

Как распознать подделку?

Точность и высокое качество дипфейков вызвали рост недоверия пользователей Сети к видеоконтенту. Однако при более внимательном рассмотрении в некоторых роликах заметны цифровые артефакты — недостатки, которые выдают имитацию. Для обоих поколений дипфейков (ранних недостаточно реалистичных и поздних гиперреалистичных) выявление артефактов происходит по одним и тем же участкам лица. Ученые из Университета Эрлангена–Нюрнберга описали возможные ограничения в своей статье.

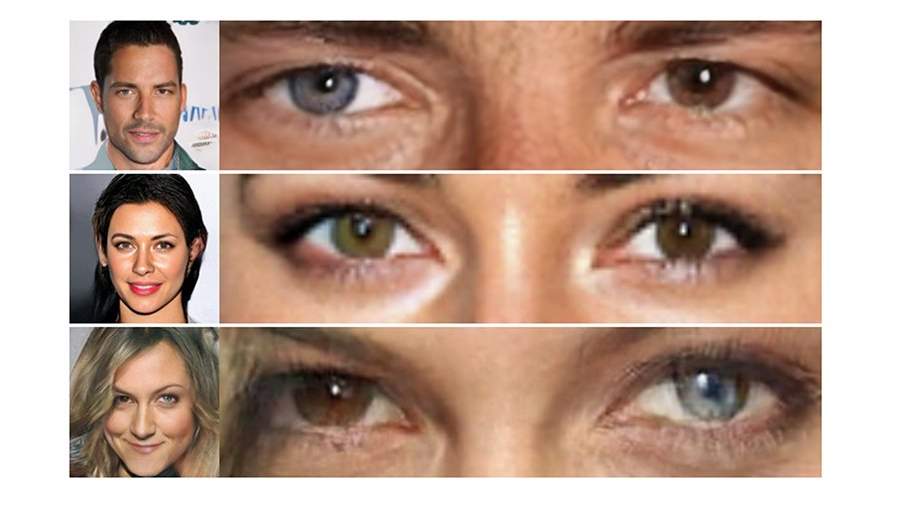

Несуществующие лица. Часто у сгенерированных моделей не совпадает цвет левого и правого глаза. В природе явление гетерохромии встречается весьма редко, поэтому смешанные или отличающиеся цвета могут стать сигналом для опознания дипфейка. Также стоит иметь в виду, что расстояние от центра глаза до края радужной оболочки должно быть одинаковым для обоих глаз. Кроме того, ожидается, что оба лимба будут иметь правильный округлый контур. Обнаруженные артефакты проиллюстрированы на картинках ниже.

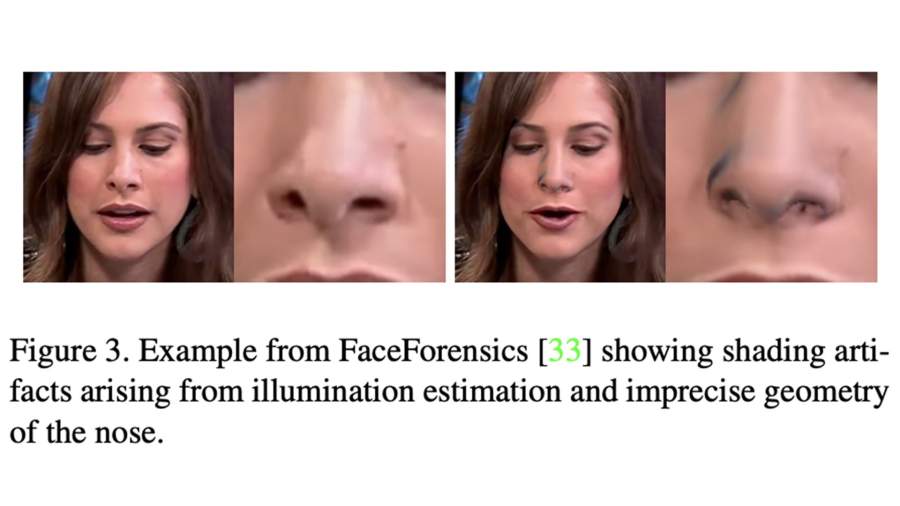

Face2Face. Для данного метода будут показательны границы лица и кончик носа. Неточное наложение маски приводит к артефактам затемнения, когда, например, одна сторона носа может казаться темнее другой. При этом контуры маски резко отделяются: это хорошо видно внизу лица и над бровями. Элементы, которые частично закрывают части лица (например, пряди волос), моделируются неправильно и могут привести к образованию «дыр».

DeepFake. Для дипфейков наиболее уязвимыми считаются глаза и зубы. Многие образцы имеют неубедительные зеркальные отражения — блики в глазах либо отсутствуют, либо кажутся упрощенными. Этот артефакт делает глаза тусклыми. Другой минус — непрорисованные зубы. Бывает, они вообще не моделируются, а выглядят как отдельное белое пятно.

Дипфейки: дезинформация или шаг в будущее?

Фейки на выборах и «воскрешение» из мертвых

Совсем недавно, на рубеже XX и XXI веков, сверхпопулярной была программа Photoshop. Теперь на смену ей пришли нейросети, а именно дипфейки (Deepfake). Эта технология куда опаснее, но также перспективнее прежней возможности грубо вырезать лица людей с фотографий и приклеивать их на другие снимки.

Другая история произошла в 2020 году на выборах в Индии. В Дели лидер одной из оппозиционных партий Маноджа Тивари сделал заявление на хинди и на диалекте хариани. При этом говорить на этом языке он не умел. Пойти на обман Маноджа Тивари решился скорее всего из-за желания завоевать голоса рабочих-мигрантов в Дели. Они как раз говорят на диалекте хариани.

И подобных случаев уже много. В истории с лидер ом индийской оппозиции интересно то, что он так и не признался в использовании технологии: доказать это довольно сложно, вот и признаваться необязательно.

Еще один пример — фильм «Би-би-си» «Добро пожаловать в Чечню» про активистов, критикующих власть. Создатели картины не стали «замазывать» лица оппозиционеров, а наложили на них дипфейки активистов, живущих в Нью-Йорке.

Можно ли вычислить дипфейки

Сложность в борьбе с нечестным использованием технологии заключается в том, что подделки будут становиться только качественнее.

Дипфейк — это генеративно-состязательная сеть. В ней есть генератор и дискриминатор. Генератор создает подделку, а дискриминатор критикует и указывает на ее недостатки. После этих замечаний генератор снова приступает к работе. В итоге появляется очень точный фейк.

Некоторые страны приняли решение регулировать дипфейки законом.

В 2020 году Калифорнийский и Стэндфордский университеты смогли повысить точность выявления дипфейков до 97%. Ученые исследовали виземы и фонемы.

Виземы — визуальное выражение того, как произносится тот или иной звук. Условно — мы говорим что-то и наш рот как-то движется. Филологи пытаются сравнить виземы в дипфейках и в оригинальных видео. Действительно, виземы в дипфейках выглядят немного иначе. Если обучить алгоритмы на таком поле данных, точность распознавания подделки будет достаточно высокая.

Другой способ вычисления обмана — изучение того, как шумит реальное и поддельное видео. Шум в дипфейках немного другой, и часто это удается услышать.

Другая сторона дипфейков

С помощью генеративных нейронных сетей можно создавать контент, используя минимальное количество данных. С этой точки зрения технология связана совсем не с «пересадкой» лиц для веселья, а с практической целью. Сейчас по одной фотографии и тексту возможно генерировать видео. Текст синтезируется в аудио, по аудио анимируются фотографии — в итоге мы получаем говорящего спикера. С помощью этого комплекса алгоритмов можно очень быстро создавать видеоконтент.

Дипфейки могут «воскрешать» любимых актеров. Например, Филип Сеймур Хоффман и Пол Уокер, умершие во время съемок фильмов с их участием («Голодные игры: Сойка-пересмешница» и «Форсаж 7» соответственно), были воссозданы в цифровом виде. А Кэрри Фишер «воскресили» для съемок в девятом эпизоде «Звездных войн».

Мария Чмир, гендиректор Deepcake.io, утверждает, что скоро появится инструмент, который полностью изменит интерактивность. Сегодня все, что дают зрителям, — это выбрать концовку сериала. В будущем с помощью дипфейков мы сможем оказаться внутри киновселенной вместе со своими друзьями. Будет возможность и менять надоевших актеров. Ведь генеративные нейросети позволяют существенным образом редактировать, видоизменять и трансформировать контент.

Именно поэтому дипфейки — это не только манипуляция и дезинформация. С помощью них можно будет снимать фильмы со спецэффектами, оживлять персонажей и в целом добавить новый опыт потребления контента.

Дипфейки: что это такое, зачем и кому они нужны + 13 кейсов

Том Круз решил «побаловать себя»: ест чупа-чупс, находит в нем жвачку и удивляется. Все это, естественно, практически в прямом эфире. Звезды все ближе к обычным людям! Или нет? Нет, это всего лишь deepfake-версия Тома Круза, но сходство впечатляющее, правда?

В этой статье рассказываем о том, что такое дипфейки, как их создают, чем они опасны, а также делимся кейсами их использования не только в формате шуточных видео, но и в «серьезном» маркетинге.

Что такое дипфейки

В начале 2021 года TikTok-видео с участием Тома Круза и правда набрали популярность. Поражают и внешнее сходство дипфейка с актером, и то, как точно передан его знаменитый смех. Этого «Тома Круза» создал Крис Уме, бельгийский специалист по deepfake-эффектам.

Deepfake (deep learning, «глубокое обучение» + fake «фейк, подделка) — методика синтеза изображения, основанная на искусственном интеллекте. Она используется для соединения и наложения существующих изображений и видео на исходные изображения или видеоролики.

В создании дипфейков участвуют GAN — генеративно-состязательные сети. Генеративная часть алгоритма, обучаясь на существующих фото, создает изображение. А состязательная — буквально «соревнуется» с первой частью алгоритма, стараясь отличить настоящие изображения от ненастоящих. В процессе этого соревнования и создаются дипфейки — изображения и видео, которые действительно трудно отличить от реальных, созданных человеком.

Даниил Охлопков, Data Lead в Runa Capital: «Сгенерированные изображения и видео со временем станут реалистичнее. Будет меньше видимых артефактов — следов того, что изображение было сгенерировано нейронной сетью.

Обратите внимание, на первой картинке слева появился перевернутый рот, на второй смазаны зубы. Аналогичные неточности (артефакты) можно находить и на видео с дипфейками.

Сейчас для создания фотореалистичного deepfake необходима постобработка. Это наглядно показали создатели видео, где актер Том Круз баллотируется в президенты США.»

На мой взгляд, технологию ожидает бумообразный рост в ближайшие несколько лет. Нынешний уровень развития технологии и ее перспективы стимулируют интерес, а значит, все больше разработчиков будут применять и использовать ее для решения своих задач. Решения будут все доступнее, дешевле и при этом качественнее.

На развитие будет сильно влиять то, как эта технология воспримется законодательно.

С одной стороны, все понимают, что мировую эволюцию deepfake не сдержать силами государства в отдельных странах.

С другой, это одна из наиболее опасных технологий в рамках текущей парадигмы безопасности, которая поддерживает мнение о том, что биометрия — отличный способ идентифицировать человека.

Григорий Иванов, основатель группы компаний Neutronix

Опасность технологии

У дипфейков практически безграничные возможности: с их помощью можно «заставить» кого угодно говорить и делать что угодно. В 2018 году режиссер Джордан Пил создал видео, на котором Барак Обама говорит об опасности дипфейков и fake news (фальшивые новости) в целом:

«It may sound basic, but how we move forward in the age of information is going to be the difference between whether we survive or whether we become some kind of fucked-up dystopia».

«Это прозвучит банально, но пока мы на пути к веку информации, главный вопрос для нас — сможем ли мы выжить, или мир превратится в какую-то извращенную антиутопию».

На видео Обама ругает Трампа, не стесняясь выражений, и очень легко поверить в то, что это действительно бывший президент США. Видео было создано, чтобы предупредить пользователей об опасности дипфейков, а также призвать их не верить всему, что они видят.

Кроме того, дипфейки могут «помочь» развитию мошенничества в интернете или даже по телефону. В 2019 году CEO британской энергетической компании заплатил мошенникам 220 тыс. евро, потому что думал, что об этом попросил его босс, голос которого в телефонном разговоре сгенерировали киберпреступники.

В связи с этими проблемами появились программы и гранты для тех, кто создаст лучший детектор дипфейков.

Facebook активно занимается изучением дипфейков и способов им противостоять. В созданном компанией Deepfake Detection Challenge поучаствовали более 2 тыс. специалистов. Благодаря этому челленджу у AI-исследователей появятся новые методы для распознавания дипфейков, которые несут угрозу обществу.

В России на похожее исследование было выделено почти 5 млн р.

Будет война генераторов реалистичных дипфейков и их детекторов. Уже сейчас Facebook инвестирует в это направление, а на сайте по анализу данных Kaggle проходят соревнования на лучший детектор дипфейков. Twitter недавно добавил возможность помечать контент как фейк, включая видео с дипфейками. Решением может стать обязательное использование водяных знаков.

Даниил Охлопков, Data Lead в Runa Capital

«Хорошие» кейсы

Дипфейки сами по себе не опасны. Есть и хорошие кейсы использования deepfake-технологий.

Например, дипфейки могут помогать людям. У Microsoft есть приложение Seeing.AI для слепых и слабовидящих людей: cинтезированный голос комментирует все, что происходит вокруг человека с нарушениями зрения, помогая ему ориентироваться в мире

Дипфейки можно применять в образовании. WPP — британский международный холдинг в области коммуникаций, рекламы, связей с общественностью, технологий и торговли. Во время пандемии COVID-19 этой компании понадобилась программа для корпоративного обучения. Это было как раз в разгар локдауна, поэтому сделать видео с реальными спикерами было невозможно.

WPP обратилась к Synthesia, компании, специализирующейся на AI, и те создали для них обучающую программу, где в качестве лекторов выступают deepfake-аватары.

Дипфейки используются и в искусстве. Специалисты из Сколково и Samsung «оживили» Мону Лизу:

Кстати, при создании «Форсаж-7» тоже использовались deepfake-технологии. Получается, в теории они могут помочь решить проблему с дублерами и удешевить производство видеоконтента.

Представьте, как много рекламного и промо-контента можно генерировать даже без участия реальных знаменитостей. Может, в будущем они будут просто продавать свои образы, а студии получат возможность делать невероятный, но очень реалистичный контент. Меньше времени на съемку, возможность участвовать сразу в нескольких проектах одновременно вообще не выходя из дома. Все это — потенциально огромные рекламные контракты.

Юлия Плосконосова, аккаунт-директор Mailfit

Применение в маркетинге и рекламе

Можно ли применять deepfake-технологии в рекламе? Да! Ниже — несколько успешных кейсов, которые могут послужить референсами для ваших рекламных кампаний.

Vivienne Sabo

Бренд косметики — один из российских пионеров применения deepfake-технологий. В 2020 году компания запустила рекламный видеопроект с использованием технологии замены лиц.

На сцене кабаре мог оказаться каждый. Достаточно было загрузить свое фото на специальном лендинге или в приложении на базе Vk Mini Apps и получить видео. Кампания уже завершена, так что сделать видео больше нельзя.

Технология дополненной реальности позволяет покупателю примерить одежду, обувь, бижутерию, попробовать макияж виртуально. Deepfake-технология способна сделать то же самое. В отличие от AR, она показывает не просто то, подходит ли вещь, а как сам человек выглядит с ней со стороны.

Алексей Рыбаков, генеральный директор IT-компании Omega

Clarins

Этот бренд косметики тоже предлагает примерить макияж не выходя из дома. Нужно всего лишь перейти на страницу средства в интернет-магазине и нажать кнопку «Макияж онлайн». Можно загрузить фото из галереи телефона или снять новое. Примерять можно средства для лица, глаз и губ.

Похожие инициативы есть у Maybelline New York, NYX, Armani, Mary Kay, L’Oreal Paris (там даже можно «примерить» цвет волос и определиться с краской) — в общем, у многих марок косметики.

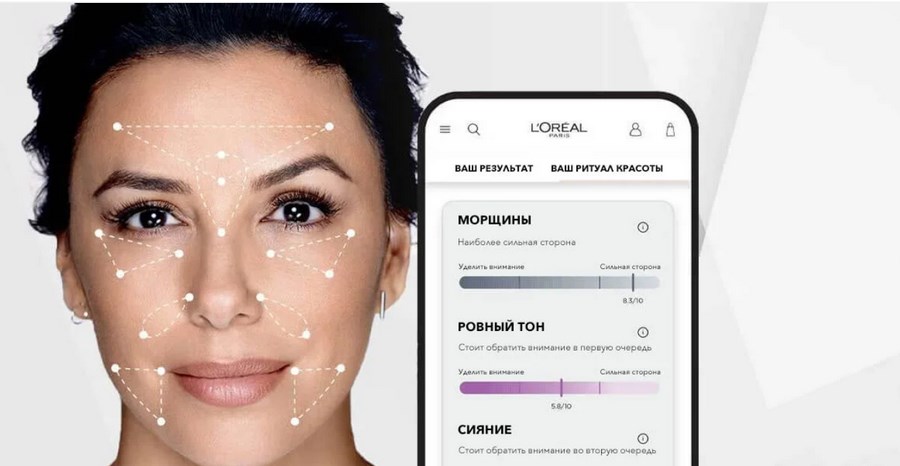

L’Oreal Paris

Кстати, о L’Oreal. У компании есть не только примерка макияжа онлайн. Skin Genius от L’Oreal — это digital-инструмент, который анализирует качество кожи в реальном времени с помощью AI. Программа сравнивает кожу с 10 000 реальных снимков от экспертов-дерматологов и на основе анализа рекомендует активные ингредиенты и конкретные советы и продукты по уходу за кожей.

С помощью deepfake-технологий «Сбер» «вернул к жизни» Жоржа Милославского, героя фильма «Иван Васильевич меняет профессию».

Герой предновогодней рекламы оказался в 2020 году, прокатился на «Ситимобиле», воспользовался приложением «Сбер.Онлайн», послушал музыку в «Сбер.Звуке», оплатил покупки телефоном, получил доставку из «Сбер.Маркета» и попал на концерт NILETTO.

Для воссоздания голоса героя была использована технология text-to-speech и реальные записи речи актера (Леонида Куравлева) общей длиной около 4-х минут. Несмотря на то, что это очень мало, специалистам «Группы ЦРТ» удалось синтезировать голос Милославского.

ESPN & Netflix

ESPN, американский кабельный канал, запустил рекламу документального сериала о Майкле Джордане («The Last Dance»). В рекламе спортивный ведущий Кенни Мэйн в 1998 году делает предсказания о том, что в 2020 ESPN снимет шоу о звезде баскетбола, а еще что «джинсы будут очень узкими», в целом делая отсылки к тому, каким будет будущее. Конечно, это не настоящий Кенни Мэйн, а его deepfake-версия.

Дипфейки удешевляют производство рекламы и любого видеоконтента. Недавно HBO сняла рекламу своего спортивного канала, в котором должны были принять участие звезды NBA. Из-за карантина путешествия и личные встречи со спортсменами были ограничены, поэтому создатели ролика сняли актеров с похожей внешностью, а потом с помощью технологии наложили лица реальных спортсменов.

Чтобы сделать видео, присутствие знаменитости на съемочной площадке вовсе не обязательно, а значит и гонорар звезды может быть значительно меньше.

Даниил Охлопков, Data Lead в Runa Capital

Malaria No More

Если компания работает на несколько рынков, снимать каждый раз новый ролик для каждого языка нет необходимости. Алгоритмы могут настроить движения лица модели и речь под необходимую языковую аудиторию.

Алексей Рыбаков, генеральный директор IT-компании Omega

Deepfake-технологии могут помочь брендам привлечь клиентов с помощью целенаправленных и персонализированных сообщений. Инфлюенсерам и селебрити дипфейки помогут больше и лучше взаимодействовать с аудиторией. Например, знаменитость может выступить в рамках модной рекламной кампании, даже не приходя на фотосессию.

Deepfake помогает повысить вовлечннность. К примеру, в 2020 году приложение Reface AI позволило пользователям виртуально примерить одежду Gucci.

В ретейле есть перспективы персонализировать обслуживание клиентов, используя deepfake-помощника, который обрабатывает онлайн-запросы, разговаривая с клиентом на одном языке. Так покупатели могут разговаривать с «настоящим» лицом, что повышает доверие к сервису.

Виталий Миняйло, сооснователь и СЕО IT-компании neurotrack.tech

Онлайн-примерочная

Русскоязычный разработчик Алексей Чаплыгин создал технологию, которая позволяет виртуально изменять параметры тела. Автор разрабатывал технологию для виртуальных примерочных, чтобы люди при просмотре одежды в интернет-магазине могли видеть вещи на себе, а не на моделях.

Бизнесу можно и нужно использовать дипфейки, если соблюдены два условия: на это есть колоссальные бюджеты, и остальные способы персонализации взаимодействия с аудиторией уже испробованы.

Сегодня deepfake — все еще дорогая технология, доступная далеко не каждой компании. Компаниям со скромными бюджетами предлагаем вместо одного взрывного ролика разработать грамотную стратегию продвиженияи вложиться в постоянный стабильный рост.

Раньше обращение телевизионной картинки прямо к конкретному зрителю было лишь сюжетом фантастических фильмов. Но теперь один и тот же рекламный ролик может быть настроен, например, под имя конкретного пользователя или сегмент целевой аудитории, которые не смогут понять, что движениями губ управляют алгоритмы, а не человек.

Алексей Рыбаков, генеральный директор IT-компании Omega

Скорее всего, технология станет привычным инструментом типа Photoshop. Ее можно будет использовать как в хороших целях — удешевление стоимости видеопродакшена с дорогими актерами, так и в сомнительных — для создания фейковых видео с известными личностями.

Даниил Охлопков, Data Lead в Runa Capital

Что думаете о развитии дипфейков? Видите в них качественный рекламный инструмент или пока не готовы использовать в работе?