что такое дип фейк

Дипфейки: что это за технология и почему она опасна

Слово deepfake появилось несколько лет назад. Оно объединяет в себе два понятия: глубокое обучение (deep learning), то есть обучение нейросетей, и подделку (fake). Технология дипфейков заключается в синтезе ИИ человеческих изображений: алгоритм объединяет несколько фото, на которых человек изображен с разным выражением лица, и делает из них видео. При этом ИИ анализирует большое количество снимков и учится тому, как может выглядеть и двигаться конкретный человек. Об этом пишет американское издание Forbes.

С распространением дипфейков появились случаи «дискредитации» публичных личностей, чьих изображений много в открытом доступе. Например, весной 2019 года в Сети было опубликовано дипфейк-видео со спикером палаты представителей конгресса США Нэнси Пелоси. Автор ролика с помощью ИИ изменил речь Пелоси так, что она плохо выговаривала слова, и пользователи, посмотревшие видео, посчитали, что политик пьяна. Ситуация вылилась в громкий скандал, и лишь спустя некоторое время было доказано, что речь Пелоси была сгенерирована ИИ.

Этот дипфейк был сделан достаточно просто. Но есть и сложные алгоритмы. Они не просто меняют тембр голоса или замедляют речь, а генерируют такие видео, на которых человек делает то, чего никогда не совершал, или говорит то, чего никогда не говорил. Со временем дипфейки будут становиться все более реалистичными, пишет американское издание Forbes. Уже сейчас технология претендует на то, чтобы влиять на политику, а в дальнейшем такие видео и вовсе смогут стать угрозой национальной безопасности.

6 лучших Deepfake приложений и инструментов в 2021 году

Различные методы манипулирования изображениями были введены в 19 веке и позднее применялись к кинофильмам. Эти методы быстро улучшились с цифровым видео.

В начале 1990-х годов исследователи из академических институтов разработали технологию Deepfake, которая впоследствии была доработана разработчиками в онлайн-сообществах. В последнее время подделки Deepfake привлекают большое внимание за их использование в финансовых махинациях, розыгрышах и фальшивых новостях.

Это заставило правительство и промышленность выявлять и ограничивать их незаконное использование. Тем не менее технология имеет большой потенциал, если ее правильно использовать.

Что такое технология Deepfake?

Deepfakes относятся к манипулируемому визуальному контенту, генерируемому сложным искусственным интеллектом, который дает сфабрикованные изображения и звуки, которые кажутся реальными. В большинстве случаев, человек в существующем видео или изображении заменяется на чье-то подобие.

Хотя трудно создать хороший deepfake на обычном компьютере, есть много инструментов, доступных в интернете, чтобы помочь людям сделать достойные deepfakes. Технология все еще находится в зачаточном состоянии, поэтому не ожидайте идеального результата.

Мы тщательно собрали несколько хороших deepfake приложений и инструментов, которые не требуют высокого класса рабочего стола с мощными графическими картами (за исключением одного или двух). Вы можете использовать их как в исследовательских целях, так и просто для развлечения, но не нарушайте чью-либо частную жизнь.

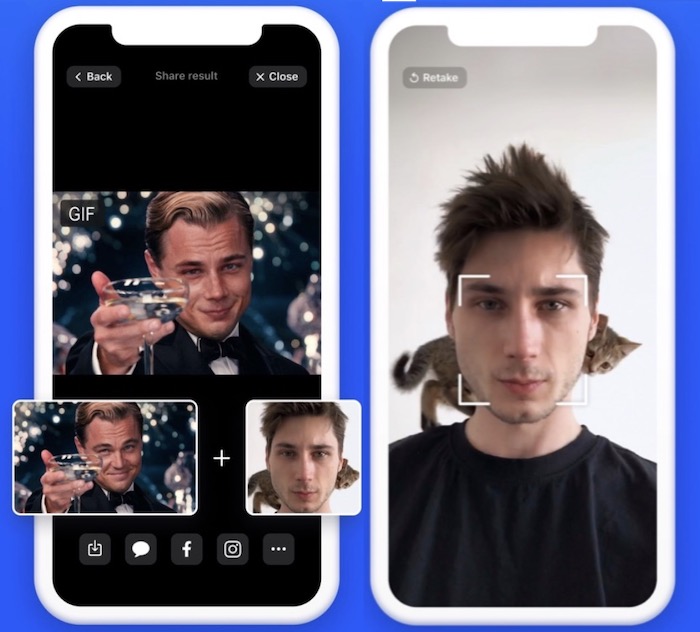

6. Doublicat

Платформа: Android / iOS

Цена: Бесплатно

Doublicat позволяет вам сделать селфи и поместить свое лицо на мем или GIF в своей библиотеке. Это займет около 5 секунд, чтобы ваше лицо было наложено на лицо Брэда Питта, Леонардо Ди Каприо или Тейлора Свифта.

Вы будете удивлены, увидев, насколько хорошо ваше наложенное лицо принимает те же выражения, что и оригинал. Вы можете переслать результаты своей семье и друзьям или опубликовать их в Instagram.

Вывод будет довольно странным, если будет много движений лица, но в целом это интересный эксперимент. По словам разработчиков приложения, само изображение удаляется с серверов сразу после его обработки. Однако при этом сохраняется представление черт лица.

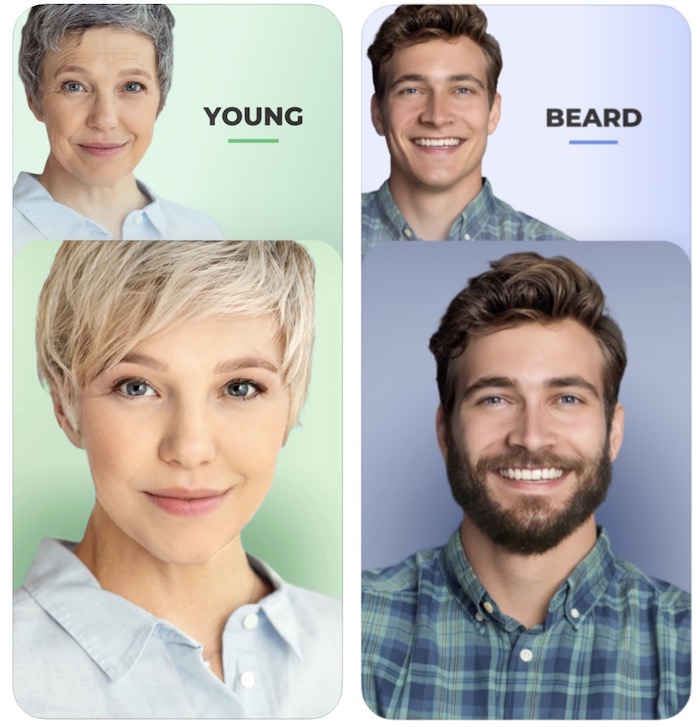

5. FaceApp

Платформа: Android / iOS

Цена: Бесплатно

FaceApp разработан российской компанией Wireless Lab. Он использует нейронные сети для генерации высокореалистичных преобразований лиц на фотографиях.

Приложение может преобразить ваше лицо, чтобы заставить его улыбаться, выглядеть старше, выглядеть моложе или просто смены пола, а также многих других захватывающих преобразований. Татуировки, виньетки, размытие объектива и наложение фона также являются частью FaceApp.

В 2018 году приложение привлекло много внимания со стороны трансгендерных и ЛГБТ-сообществ из-за его реалистичных преобразований гендерных изменений. Он также столкнулся с критикой как в социальных сетях, так и в прессе за конфиденциальность пользовательских данных.

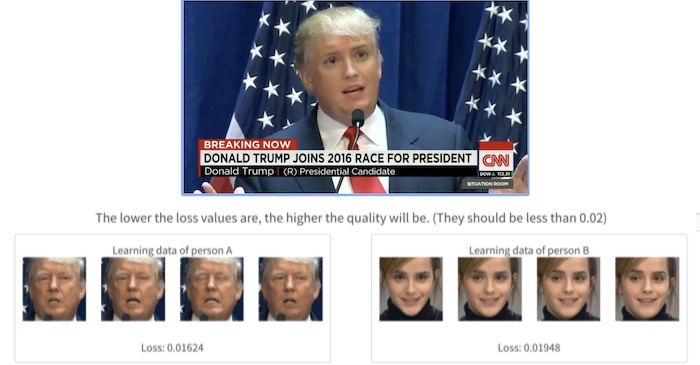

4. Deepfakes web β

С помощью этого инструмента вы можете создавать deepfake видео в интернете. Однако кривая обучения здесь немного больше, чем то, что вы найдете в других приложениях.

Вам нужно зарегистрироваться и загрузить свои видео. Все остальное происходит в облаке, где используются мощные графические процессоры. На изучение видео/изображений и смену лиц уходит почти 4 часа. Вы также можете использовать обученную модель, чтобы менять лица, что занимает около 30 минут.

Качество выходного видео зависит от значений «потерь»: чем ниже значения потерь (при обучении из загруженных видео), тем выше качество. И, конечно, только вы можете получить доступ к своим видео и учебным данным.

3. DeepFaceLab

Платформа: Windows

Цена: Бесплатный

DeepFaceLab является ведущим программным обеспечением для создания подделок. Она использует новые нейронные сети для замены лиц в видео. Она размещена на GitHub и породила бесчисленное множество видео в интернете.

По словам его разработчиков, более 95% глубоких подделок видео создаются с помощью DeepFaceLab. Его используют несколько популярных каналов YouTube, таких, как Ctrl Shift Face, iFake и Shamook.

DeepFaceLab прекрасно работает, но для его использования необходимы технические знания. Как только вы загрузите и разархивируете инструмент, вы увидите множество папок и ряд командных файлов. Существует папка с именем «workspace», которая содержит все обучающие модели, исходные видео и выходные данные. Инструмент работает с определенными именами и местоположениями файлов, чтобы пакетный файл мог функционировать.

2. FaceSwap

Платформа: Windows | MacOS | Linux

Цена: бесплатно

FaceSwap похож на DeepFaceLab, но предоставляет больше возможностей, лучшую документацию и лучшую онлайн-поддержку. И да, он также доступен на Mac и Linux.

Это инструмент с открытым исходным кодом, наполненный функциональностью для выполнения каждого шага процесса Deepfake, от импорта первоначального видео до создания финального видео Deepfake. Чтобы запустить этот инструмент, вам нужна мощная видеокарта, так как замена лица происходит невероятно медленно.

Работая на Python, Keras и Tensorflow, Faceswap имеет активное сообщество, поддерживающее и разрабатывающее программное обеспечение. Есть много учебников, которые помогут вам начать работу.

1. Zao

Платформа: Android | iOS

Цена: бесплатно

Технология глубокой подделки Zao позволяет вам модулировать голоса знаменитостей и накладывать свое лицо на тело актера в сцене.

Просто нажмите на одну фотографию и попробуйте тысячи модных причесок, одежды и макияжа. Приложение предоставляет вам множество видеоклипов, нарядов и буквально неограниченные возможности для изучения.

В 2019 году Zao за короткое время приобрел значительную популярность, позволив пользователям обмениваться лицами с любимыми актерами в коротких клипах из телепередач и фильмов. За месяц он стал самым загружаемым бесплатным приложением в Китае. С ростом популярности, его разработчики также столкнулись с критикой политики конфиденциальности приложения.

Это займет всего несколько секунд, чтобы поменять ваше лицо, но так как алгоритм в основном обучен на китайских лицах, это может выглядеть не так естественно, как вы ожидаете.

Тем не менее все эти инструменты демонстрируют, как быстро развивался базовый ИИ: то, что раньше требовало тысячи картинок, чтобы сделать достаточно убедительное глубокое поддельное видео, теперь требует только одного изображения и дает лучшие результаты.

Дипфейки и другие поддельные видео – как защитить себя?

Дипфейки: новые технологии обмана

Слово дипфейк (Deepfake) является составным и происходит от deep learning (глубинное обучение) и fake (фейк, подделка). Глубинное обучение – это сложный метод на базе искусственного интеллекта, который использует многоуровневые алгоритмы машинного обучения для извлечения все более сложных характеристик из необработанных входных данных. При этом ИИ способен обучаться на неструктурированных данных – таких как изображения лиц. Например, ИИ может собрать данные о движениях вашего тела.

Затем эти данные могут быть обработаны для создания дипфейк-видео при помощи так называемой генеративно-состязательной сети (Generative Adversarial Network, или GAN). Это еще одна специализированная система машинного обучения. В ней задействовано две нейросети, которые состязаются друг с другом, изучая характеристики учебных наборов данных (например, фотографий лиц) и создавая новые данные на базе этих характеристик (то есть новые «фотографии»).

Поскольку такая сеть постоянно сверяет создаваемые образцы с исходным учебным набором, поддельные изображения выглядят все более и более правдоподобно. Именно поэтому угроза, которую представляют дипфейки, постоянно растет. Кроме того, сети GAN могут создавать и другие поддельные данные помимо фотографий и видео. Например, дипфейк-технологии могут использоваться для имитации голоса.

Примеры дипфейков

Качественные дипфейки с участием знаменитостей найти несложно. Один из примеров – фейковое видео, выложенное актером Джорданом Пилом. Он записал небольшую речь голосом Барака Обамы, которая затем была совмещена с видеосъемкой реального выступления этого политика. Затем Пил продемонстрировал, как выглядят обе составляющие этого видео, и призвал своих зрителей критически относиться ко всему, что они видят.

Видео с руководителем Facebook Марком Цукербергом, в котором тот якобы говорит о том, как Facebook «управляет будущим» с помощью украденных данных пользователей, появилось в Instagram. На оригинальном видео запечатлена его речь в связи со скандалом о «русском следе» в выборах президента США – для создания фейка оказалось достаточно фрагмента длиной всего в 21 секунду. Однако голос Цукерберга был сымитирован не так хорошо, как в пародии Джордана Пила на Обаму, и фальшивку было легко распознать.

Впрочем, даже менее качественные подделки могут вызвать живой отклик. Видео с «пьяной» Нэнси Пелоси, спикером Палаты представителей США, набрало миллионы просмотров на YouTube – а это был всего лишь фейк, сделанный с помощью замедления реального видео, чтобы создать видимость невнятной речи. Кроме того, немало известных женщин внезапно обнаружили себя в роли порнозвезд – их лица были вмонтированы в порнографические ролики и изображения.

Мошенничество и шантаж с использованием дипфейков

Дипфейк-видео неоднократно использовались в политических целях, а также как способ мести. Однако сейчас к этим технологиям все чаще стали прибегать для шантажа и проворачивания крупных афер.

У генерального директора британской энергетической компании мошенники смогли выманить 220 000 евро с помощью дипфейковой имитации голоса руководителя головной компании, якобы запросившего срочно перевести указанную сумму. Подмена была настолько натуралистичной, что обманутый директор не стал перепроверять информацию, хотя средства переводились не в головной офис, а на сторонний счет. Только когда «босс» запросил еще один трансфер, его собеседник заподозрил неладное, но переведенные деньги уже бесследно исчезли.

Во Франции недавно прогремела афера, в которой, правда, технология дипфейков не использовалась, – мошенник по имени Жильбер Шикли выдавал себя за министра иностранных дел Франции Жана-Ива Ле Дриана, с большой точностью воссоздав не только его внешность, но и обстановку рабочего кабинета. Аферист от имени министра обращался к состоятельным частным лицам и руководителям компаний с просьбой выделить средства на выкуп французских граждан, оказавшихся в заложниках террористов в Сирии. Таким образом ему удалось выманить несколько миллионов евро. Сейчас это дело рассматривается в суде.

Авторы дипфейков могут шантажировать руководителей крупных компаний, угрожая опубликовать фейковое видео, способное подорвать их репутацию, если те не заплатят отступные. Также мошенники могут, например, проникнуть в вашу сеть, сымитировав звонок от IT-директора и обманом заставив сотрудников предоставить пароли и привилегии доступа, после чего ваши конфиденциальные данные окажутся в полном распоряжении хакеров.

Фейковые порноролики уже использовались с целью шантажа женщин-репортеров и журналисток, как, например, произошло в Индии с Раной Айюб, которая занималась разоблачением злоупотреблений властью. Технологии производства дипфейков дешевеют, так что можно прогнозировать рост их использования в целях шантажа и мошенничества.

h2>Как защититься от дипфейков?

Проблему дипфейков уже пытаются начать решать на законодательном уровне. Так, в штате Калифорния в прошлом году было принято два закона, ограничивающих использование дипфейков: законопроект AB-602 запретил использование технологий синтеза изображений человека для изготовления порнографического контента без согласия изображаемых, а AB-730 – подделку изображений кандидатов на государственные посты в течение 60 дней перед выборами.

Но окажутся ли эти меры достаточными? К счастью, компании в сфере безопасности постоянно разрабатывают все более совершенные алгоритмы распознавания. Они анализируют видеоизображения и замечают незначительные искажения, возникающие в процессе создания фальшивки. Например, современные генераторы дипфейков моделируют двумерное лицо, а затем искажают его для встраивания в трехмерную перспективу видеоролика. По тому, куда направлен нос, легко распознать подделку.

Пока что технологии создания дипфейков еще недостаточно совершенны, и признаки подделки зачастую видны невооруженным глазом. Обращайте внимание на следующие характерные признаки:

Однако по мере совершенствования технологий ваши глаза все реже будут распознавать обман – а вот хорошее защитное решение обмануть будет куда сложнее.

Уникальные антифейковые технологии

Некоторые развивающиеся технологии уже помогают создателям видеоконтента защищать его аутентичность. С помощью специального шифровального алгоритма в видеопоток с определенными интервалами встраиваются хеши; если видео будет изменено, хеши также изменятся. Создавать цифровые сигнатуры для видео также можно, используя ИИ и блокчейн. Это похоже на защиту документов водяными знаками; в случае с видео, правда, трудности заключаются в том, что хеши должны оставаться неизменными при сжатии видеопотока различными кодеками.

Еще один способ борьбы с дипфейками – использовать программу, вставляющую в видеоконтент специальные цифровые артефакты, маскирующие группы пикселей, по которым ориентируются программы для распознавания лиц. Этот прием замедляет работу дипфейк-алгоритмов, и в результате качество подделки будет более низким, что, в свою очередь, снизит вероятность успешного использования дипфейка.

Лучшая защита – соблюдение правил безопасности

Технологии – не единственный способ защититься от дипфейк-видео. В борьбе с ними весьма эффективны даже базовые правила безопасности.

Так, например, встраивание автоматических проверок во все процессы, связанные с перечислением денежных средств, позволило бы предотвратить множество мошеннических действий, в том числе и с использованием дипфейков. Также вы можете:

Помните, что, если хакеры начнут активно использовать дипфейки для проникновения в домашние и корпоративные сети, соблюдение базовых правил кибербезопасности станет важнейшим фактором в минимизации рисков:

Как будут развиваться дипфейки?

Дипфейки эволюционируют угрожающими темпами. Еще два года назад подделки легко было отличить по низкому качеству передачи движения; кроме того, люди в таких видео практически никогда не моргали. Однако технологии не стоят на месте, и дипфейки последнего поколения выполнены заметно более качественно.

По приблизительным оценкам, сейчас по Сети гуляет более 15 000 дипфейк-видео. Некоторые из них шуточные, но есть и такие, которые создавались для манипуляций общественным сознанием. Сейчас изготовление нового дипфейка занимает от силы пару дней, так что вскоре их может стать намного больше.

Дипфейки: что это такое, зачем и кому они нужны + 13 кейсов

Том Круз решил «побаловать себя»: ест чупа-чупс, находит в нем жвачку и удивляется. Все это, естественно, практически в прямом эфире. Звезды все ближе к обычным людям! Или нет? Нет, это всего лишь deepfake-версия Тома Круза, но сходство впечатляющее, правда?

В этой статье рассказываем о том, что такое дипфейки, как их создают, чем они опасны, а также делимся кейсами их использования не только в формате шуточных видео, но и в «серьезном» маркетинге.

Что такое дипфейки

В начале 2021 года TikTok-видео с участием Тома Круза и правда набрали популярность. Поражают и внешнее сходство дипфейка с актером, и то, как точно передан его знаменитый смех. Этого «Тома Круза» создал Крис Уме, бельгийский специалист по deepfake-эффектам.

Deepfake (deep learning, «глубокое обучение» + fake «фейк, подделка) — методика синтеза изображения, основанная на искусственном интеллекте. Она используется для соединения и наложения существующих изображений и видео на исходные изображения или видеоролики.

В создании дипфейков участвуют GAN — генеративно-состязательные сети. Генеративная часть алгоритма, обучаясь на существующих фото, создает изображение. А состязательная — буквально «соревнуется» с первой частью алгоритма, стараясь отличить настоящие изображения от ненастоящих. В процессе этого соревнования и создаются дипфейки — изображения и видео, которые действительно трудно отличить от реальных, созданных человеком.

Даниил Охлопков, Data Lead в Runa Capital: «Сгенерированные изображения и видео со временем станут реалистичнее. Будет меньше видимых артефактов — следов того, что изображение было сгенерировано нейронной сетью.

Обратите внимание, на первой картинке слева появился перевернутый рот, на второй смазаны зубы. Аналогичные неточности (артефакты) можно находить и на видео с дипфейками.

Сейчас для создания фотореалистичного deepfake необходима постобработка. Это наглядно показали создатели видео, где актер Том Круз баллотируется в президенты США.»

На мой взгляд, технологию ожидает бумообразный рост в ближайшие несколько лет. Нынешний уровень развития технологии и ее перспективы стимулируют интерес, а значит, все больше разработчиков будут применять и использовать ее для решения своих задач. Решения будут все доступнее, дешевле и при этом качественнее.

На развитие будет сильно влиять то, как эта технология воспримется законодательно.

С одной стороны, все понимают, что мировую эволюцию deepfake не сдержать силами государства в отдельных странах.

С другой, это одна из наиболее опасных технологий в рамках текущей парадигмы безопасности, которая поддерживает мнение о том, что биометрия — отличный способ идентифицировать человека.

Григорий Иванов, основатель группы компаний Neutronix

Опасность технологии

У дипфейков практически безграничные возможности: с их помощью можно «заставить» кого угодно говорить и делать что угодно. В 2018 году режиссер Джордан Пил создал видео, на котором Барак Обама говорит об опасности дипфейков и fake news (фальшивые новости) в целом:

«It may sound basic, but how we move forward in the age of information is going to be the difference between whether we survive or whether we become some kind of fucked-up dystopia».

«Это прозвучит банально, но пока мы на пути к веку информации, главный вопрос для нас — сможем ли мы выжить, или мир превратится в какую-то извращенную антиутопию».

На видео Обама ругает Трампа, не стесняясь выражений, и очень легко поверить в то, что это действительно бывший президент США. Видео было создано, чтобы предупредить пользователей об опасности дипфейков, а также призвать их не верить всему, что они видят.

Кроме того, дипфейки могут «помочь» развитию мошенничества в интернете или даже по телефону. В 2019 году CEO британской энергетической компании заплатил мошенникам 220 тыс. евро, потому что думал, что об этом попросил его босс, голос которого в телефонном разговоре сгенерировали киберпреступники.

В связи с этими проблемами появились программы и гранты для тех, кто создаст лучший детектор дипфейков.

Facebook активно занимается изучением дипфейков и способов им противостоять. В созданном компанией Deepfake Detection Challenge поучаствовали более 2 тыс. специалистов. Благодаря этому челленджу у AI-исследователей появятся новые методы для распознавания дипфейков, которые несут угрозу обществу.

В России на похожее исследование было выделено почти 5 млн р.

Будет война генераторов реалистичных дипфейков и их детекторов. Уже сейчас Facebook инвестирует в это направление, а на сайте по анализу данных Kaggle проходят соревнования на лучший детектор дипфейков. Twitter недавно добавил возможность помечать контент как фейк, включая видео с дипфейками. Решением может стать обязательное использование водяных знаков.

Даниил Охлопков, Data Lead в Runa Capital

«Хорошие» кейсы

Дипфейки сами по себе не опасны. Есть и хорошие кейсы использования deepfake-технологий.

Например, дипфейки могут помогать людям. У Microsoft есть приложение Seeing.AI для слепых и слабовидящих людей: cинтезированный голос комментирует все, что происходит вокруг человека с нарушениями зрения, помогая ему ориентироваться в мире

Дипфейки можно применять в образовании. WPP — британский международный холдинг в области коммуникаций, рекламы, связей с общественностью, технологий и торговли. Во время пандемии COVID-19 этой компании понадобилась программа для корпоративного обучения. Это было как раз в разгар локдауна, поэтому сделать видео с реальными спикерами было невозможно.

WPP обратилась к Synthesia, компании, специализирующейся на AI, и те создали для них обучающую программу, где в качестве лекторов выступают deepfake-аватары.

Дипфейки используются и в искусстве. Специалисты из Сколково и Samsung «оживили» Мону Лизу:

Кстати, при создании «Форсаж-7» тоже использовались deepfake-технологии. Получается, в теории они могут помочь решить проблему с дублерами и удешевить производство видеоконтента.

Представьте, как много рекламного и промо-контента можно генерировать даже без участия реальных знаменитостей. Может, в будущем они будут просто продавать свои образы, а студии получат возможность делать невероятный, но очень реалистичный контент. Меньше времени на съемку, возможность участвовать сразу в нескольких проектах одновременно вообще не выходя из дома. Все это — потенциально огромные рекламные контракты.

Юлия Плосконосова, аккаунт-директор Mailfit

Применение в маркетинге и рекламе

Можно ли применять deepfake-технологии в рекламе? Да! Ниже — несколько успешных кейсов, которые могут послужить референсами для ваших рекламных кампаний.

Vivienne Sabo

Бренд косметики — один из российских пионеров применения deepfake-технологий. В 2020 году компания запустила рекламный видеопроект с использованием технологии замены лиц.

На сцене кабаре мог оказаться каждый. Достаточно было загрузить свое фото на специальном лендинге или в приложении на базе Vk Mini Apps и получить видео. Кампания уже завершена, так что сделать видео больше нельзя.

Технология дополненной реальности позволяет покупателю примерить одежду, обувь, бижутерию, попробовать макияж виртуально. Deepfake-технология способна сделать то же самое. В отличие от AR, она показывает не просто то, подходит ли вещь, а как сам человек выглядит с ней со стороны.

Алексей Рыбаков, генеральный директор IT-компании Omega

Clarins

Этот бренд косметики тоже предлагает примерить макияж не выходя из дома. Нужно всего лишь перейти на страницу средства в интернет-магазине и нажать кнопку «Макияж онлайн». Можно загрузить фото из галереи телефона или снять новое. Примерять можно средства для лица, глаз и губ.

Похожие инициативы есть у Maybelline New York, NYX, Armani, Mary Kay, L’Oreal Paris (там даже можно «примерить» цвет волос и определиться с краской) — в общем, у многих марок косметики.

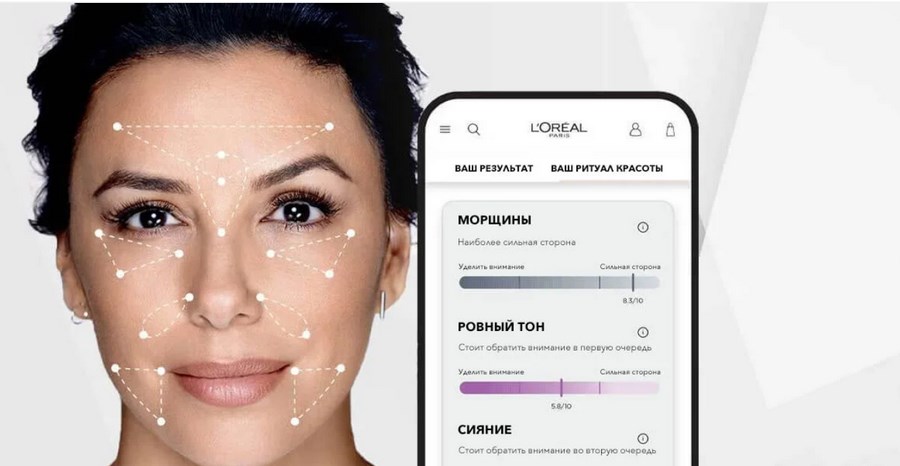

L’Oreal Paris

Кстати, о L’Oreal. У компании есть не только примерка макияжа онлайн. Skin Genius от L’Oreal — это digital-инструмент, который анализирует качество кожи в реальном времени с помощью AI. Программа сравнивает кожу с 10 000 реальных снимков от экспертов-дерматологов и на основе анализа рекомендует активные ингредиенты и конкретные советы и продукты по уходу за кожей.

С помощью deepfake-технологий «Сбер» «вернул к жизни» Жоржа Милославского, героя фильма «Иван Васильевич меняет профессию».

Герой предновогодней рекламы оказался в 2020 году, прокатился на «Ситимобиле», воспользовался приложением «Сбер.Онлайн», послушал музыку в «Сбер.Звуке», оплатил покупки телефоном, получил доставку из «Сбер.Маркета» и попал на концерт NILETTO.

Для воссоздания голоса героя была использована технология text-to-speech и реальные записи речи актера (Леонида Куравлева) общей длиной около 4-х минут. Несмотря на то, что это очень мало, специалистам «Группы ЦРТ» удалось синтезировать голос Милославского.

ESPN & Netflix

ESPN, американский кабельный канал, запустил рекламу документального сериала о Майкле Джордане («The Last Dance»). В рекламе спортивный ведущий Кенни Мэйн в 1998 году делает предсказания о том, что в 2020 ESPN снимет шоу о звезде баскетбола, а еще что «джинсы будут очень узкими», в целом делая отсылки к тому, каким будет будущее. Конечно, это не настоящий Кенни Мэйн, а его deepfake-версия.

Дипфейки удешевляют производство рекламы и любого видеоконтента. Недавно HBO сняла рекламу своего спортивного канала, в котором должны были принять участие звезды NBA. Из-за карантина путешествия и личные встречи со спортсменами были ограничены, поэтому создатели ролика сняли актеров с похожей внешностью, а потом с помощью технологии наложили лица реальных спортсменов.

Чтобы сделать видео, присутствие знаменитости на съемочной площадке вовсе не обязательно, а значит и гонорар звезды может быть значительно меньше.

Даниил Охлопков, Data Lead в Runa Capital

Malaria No More

Если компания работает на несколько рынков, снимать каждый раз новый ролик для каждого языка нет необходимости. Алгоритмы могут настроить движения лица модели и речь под необходимую языковую аудиторию.

Алексей Рыбаков, генеральный директор IT-компании Omega

Deepfake-технологии могут помочь брендам привлечь клиентов с помощью целенаправленных и персонализированных сообщений. Инфлюенсерам и селебрити дипфейки помогут больше и лучше взаимодействовать с аудиторией. Например, знаменитость может выступить в рамках модной рекламной кампании, даже не приходя на фотосессию.

Deepfake помогает повысить вовлечннность. К примеру, в 2020 году приложение Reface AI позволило пользователям виртуально примерить одежду Gucci.

В ретейле есть перспективы персонализировать обслуживание клиентов, используя deepfake-помощника, который обрабатывает онлайн-запросы, разговаривая с клиентом на одном языке. Так покупатели могут разговаривать с «настоящим» лицом, что повышает доверие к сервису.

Виталий Миняйло, сооснователь и СЕО IT-компании neurotrack.tech

Онлайн-примерочная

Русскоязычный разработчик Алексей Чаплыгин создал технологию, которая позволяет виртуально изменять параметры тела. Автор разрабатывал технологию для виртуальных примерочных, чтобы люди при просмотре одежды в интернет-магазине могли видеть вещи на себе, а не на моделях.

Бизнесу можно и нужно использовать дипфейки, если соблюдены два условия: на это есть колоссальные бюджеты, и остальные способы персонализации взаимодействия с аудиторией уже испробованы.

Сегодня deepfake — все еще дорогая технология, доступная далеко не каждой компании. Компаниям со скромными бюджетами предлагаем вместо одного взрывного ролика разработать грамотную стратегию продвиженияи вложиться в постоянный стабильный рост.

Раньше обращение телевизионной картинки прямо к конкретному зрителю было лишь сюжетом фантастических фильмов. Но теперь один и тот же рекламный ролик может быть настроен, например, под имя конкретного пользователя или сегмент целевой аудитории, которые не смогут понять, что движениями губ управляют алгоритмы, а не человек.

Алексей Рыбаков, генеральный директор IT-компании Omega

Скорее всего, технология станет привычным инструментом типа Photoshop. Ее можно будет использовать как в хороших целях — удешевление стоимости видеопродакшена с дорогими актерами, так и в сомнительных — для создания фейковых видео с известными личностями.

Даниил Охлопков, Data Lead в Runa Capital

Что думаете о развитии дипфейков? Видите в них качественный рекламный инструмент или пока не готовы использовать в работе?